Adobe Creative Cloud 2025: Cz AI wreszcie robi brudną robotę za nas?

Firefly jako centrum Creative Cloud 2025

Adobe przepakowało Firefly w coś, co jest bardziej „domem” dla generatywnej kreatywności niż pojedynczą funkcją. W jednym miejscu możesz generować obrazy, wideo, dźwięk i grafiki wektorowe, a potem jednym kliknięciem wysłać je dalej do Photoshopa, Premiere Pro czy After Effects. Największa zmiana to otwarcie się na modele zewnętrzne. Obok modeli Adobe pojawiają się też modele partnerów, między innymi od Google, OpenAI, Luma AI, Runway czy innych dostawców. W praktyce wybierasz model z listy i testujesz różne style oraz zachowania bez wychodzenia z jednego ekranu. Do tego dochodzą Content Credentials, czyli metadane dołączane do plików. Dzięki nim można sprawdzić, że w procesie pojawiło się generatywne AI. Przy pracy komercyjnej, w świecie deepfake’ów i coraz większej liczby syntetycznych obrazów, to zaczyna być ważny element higieny pracy.Firefly Boards: inteligentny moodboard dla foto i wideo

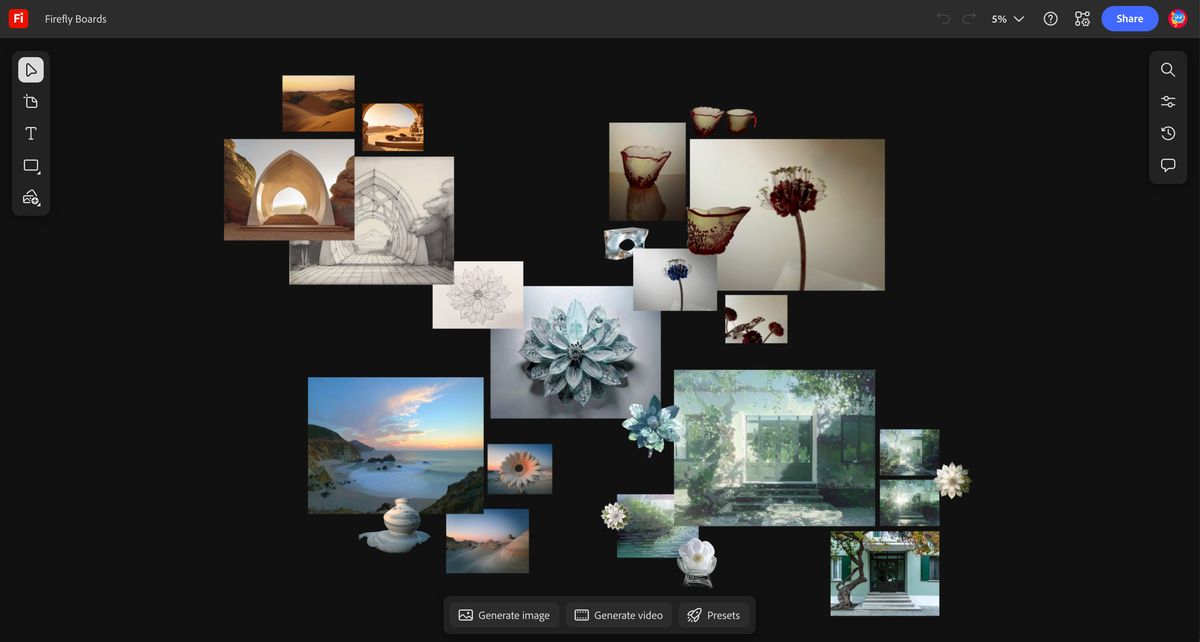

Firefly Boards to dla mnie najciekawsza nowość. Wygląda jak klasyczna nieskończona tablica, na którą wrzucasz referencje, kadry, teksty i komentarze, ale w środku jest pełno AI. Możesz na jednej tablicy mieszać generatywne obrazy, klatki z modeli wideo, pliki z Adobe Stock i własne zdjęcia. Najmocniejszy jest etap startowy. Masz dwa, trzy referencyjne kadry, wrzucasz je na tablicę, odpalasz funkcję typu „opisz obraz” i z tego generujesz gotowe prompta. Do tego dochodzą presety stylu, które jednym kliknięciem zmieniają charakter generowanych obrazów na produktowy, bardziej filmowy, modowy albo np. „character design”. Boards pozwala pracować zespołowo w czasie rzeczywistym. Reżyser, operator, grafik i klient oglądają tę samą tablicę. Można dyskutować nad konkretnym kadrem, robić warianty kolorystyczne, porównywać style i dopiero potem schodzić na poziom szczegółowych storyboardów. Dla filmowców to świetne miejsce na treatmenty, wstępne storyboardy i zestawy referencji do gradingu. Dla fotografów produktowych czy fashion to szybki sposób na przećwiczenie stylów światła, tła i kompozycji przed właściwą sesją.

Lightroom: Generative Remove zamiast godziny klonowania

W Lightroomie generatywna AI pojawia się w bardzo praktycznym miejscu. Generative Remove to nowe wcielenie narzędzia „Usuń”. Zaznaczasz pędzlem element, który przeszkadza, włączasz tryb generatywny i Lightroom wypełnia to miejsce nową treścią dopasowaną do otoczenia. Najważniejsze jest to, że działa to praktycznie wszędzie: w Lightroomie na desktopie, w Lightroom Classic, w wersji mobilnej, webowej oraz w Camera Raw. Możesz więc zaznaczyć coś szybko na tablecie, a później sprawdzić detale na dużym monitorze, bez wycieczek między aplikacjami i eksportami. W realnym użyciu to jest idealne na turystów w tle, śmietniki, znaki, kable, przypadkowe osoby, samochody albo banery reklamowe. Zamiast wysyłać każdy kadr do Photoshopa, wiele rzeczy da się załatwić w Lightroomie jednym sensownym zaznaczeniem, a narzędzie i tak podsuwa kilka wariantów do wyboru. Oczywiście nie ma magii. W detalach wciąż potrafią pojawić się artefakty, szczególnie przy ostrych krawędziach i mocnych kontrastach. Wciąż trzeba zrobić zoom i obejrzeć brzeg obiektu. Różnica jest taka, że z „godziny łatania” często robi się „pięć minut kontroli”.Photoshop: Generative Fill i Generative Expand jako ratunek dla kadrów

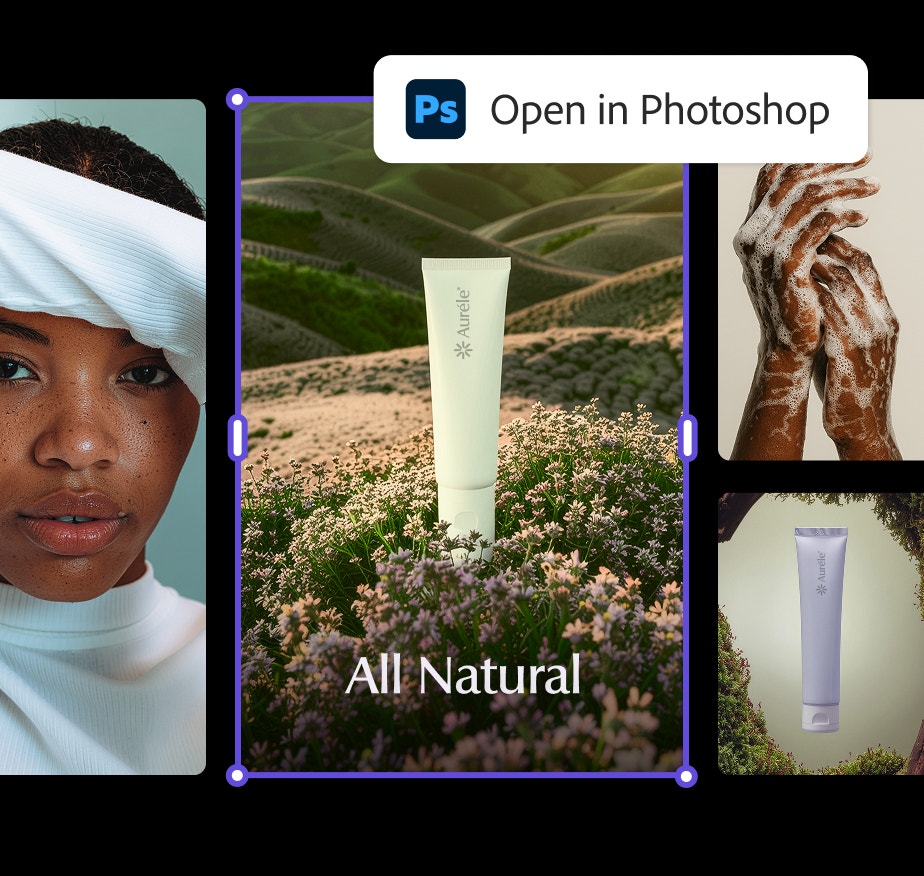

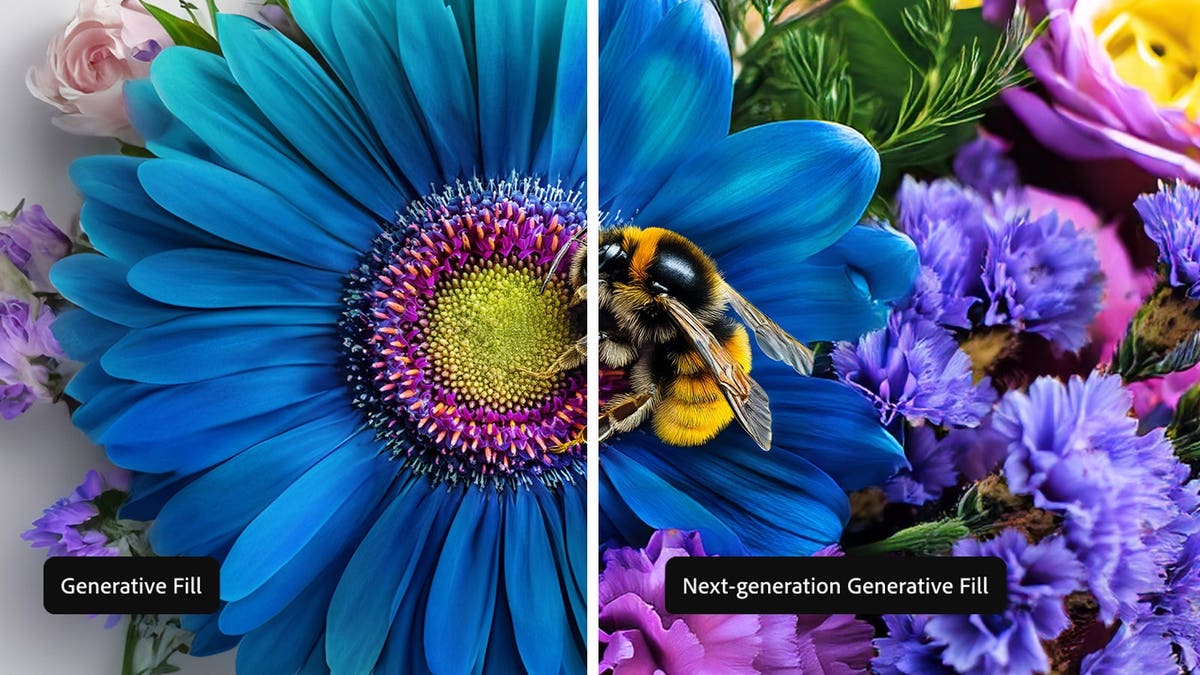

Photoshop trochę zmienia filozofię pracy. Zamiast tylko retuszować to, co jest, coraz częściej „dopowiada” resztę sceny. Generative Fill pozwala dodawać, usuwać i podmieniać elementy obrazu za pomocą tekstowych promptów. Wybierasz fragment, wpisujesz, co ma się tam pojawić, a Photoshop generuje kilka wariantów i układa je na osobnej warstwie. Drugi filar to Generative Expand. Rozszerzasz płótno narzędziem kadrowania poza oryginalny kadr i prosisz Photoshopa, żeby „dorysował” scenę. Na przykład masz poziomy kadr z planu szerokiego i nagle potrzebujesz pionowej wersji do stories. Albo plakat musi mieć inne proporcje niż pierwotnie wymyślone. Zamiast upychać kadr albo kombinować z gradientami i teksturami, można po prostu wygenerować brakujące fragmenty. Generatywne operacje działają nieniszcząco. Historia zmian jest normalnie dostępna, a wygenerowana zawartość ląduje na oddzielnych warstwach. Jeśli coś wygląda sztucznie, można to zamaskować, zmieszać z oryginalnym obrazem albo po prostu powtórzyć generację z innym promptem. W codziennej pracy oszczędza to masę czasu przy robieniu wariantów layoutów, coverów, grafik social, key visuali czy materiałów promocyjnych do kampanii wideo. Szczególnie wtedy, kiedy klient po fakcie zmienia formaty i media, a budżetu na nową sesję już nie ma.

Jak to zmienia pracę twórców

Dla filmowców Firefly Boards może stać się miejscem, w którym rodzi się cała preprodukcja. Zamiast prezentacji w PDF powstaje żyjąca tablica z moodboardem, pierwszymi kadrami, lookiem kolorystycznym i referencjami do ruchu kamery. Potem te same materiały można łatwo przenieść do narzędzi montażowych. Fotografowie dostają mocniejsze narzędzia do retuszu i adaptacji kadrów pod różne formaty. Generative Remove przyspiesza czyszczenie tła, a Generative Fill i Expand pomagają robić serie pod social media, print i kampanie outdoor, często z jednego bazowego ujęcia. Twórcy online, którzy żyją w ekosystemie Stories, Reels i Shorts, mogą myśleć o Firefly jak o szybkim studio do tworzenia teł, miniatur, grafik i krótkich klipów. Selekcja dzieje się w Boards, dopieszczanie w Photoshopie i Premiere, a publikacja już po stronie platform.Zalety i wady tego kierunku

Zalety• znacznie szybsza iteracja na etapie pomysłu, moodboardu i treatmentu,

• jedno środowisko do generowania i selekcji materiałów zamiast kilku rozproszonych narzędzi,

• nieniszczące generatywne edycje w Lightroomie i Photoshopie,

• spójne podejście do oznaczania treści generowanych AI dzięki Content Credentials. Wady

• realny koszt kredytów generatywnych i subskrypcji przy dużych projektach,

• ryzyko ujednolicenia estetyki, jeśli wszyscy korzystają z tych samych presetów i modeli,

• większy próg wejścia dla osób, które dopiero zaczynają przygodę z Creative Cloud i czują się przytłoczone ilością opcji. Na koniec zostaje to, co najważniejsze. Te narzędzia nie piszą za nas historii. Firefly nie wymyśli za nas bohaterów, a Generative Fill nie uratuje złego pomysłu. Mogą natomiast zdjąć z barków tonę powtarzalnej roboty i pozwolić skupić się na tym, co faktycznie jest nasze.

Źródła

1. Adobe MAX – strona konferencji2. Creative Cloud 2025 – nowości na Adobe MAX

3. Firefly – ogłoszenia na Adobe MAX 2025

4. Adobe Firefly – strona produktu

5. Firefly Boards – globalne wprowadzenie

6. Lightroom – funkcja Generative Remove

7. Lightroom – Generative Remove FAQ

8. Lightroom Classic – narzędzie Usuń / Generative Remove

9. Photoshop – funkcja Generative Fill

10. Photoshop – funkcja Generative Expand

Dodaj komentarz